文章主题:

🎉有幸成为混元大模型内测的一员,面对百度、阿里相继推出自家超模的浪潮,腾讯紧随其后,秉持着不落后一步的理念,迅速启动了相关项目。虽起步稍晚,但国内大模型市场壁垒犹存,文心一言仍以行业领头羊的姿态独占鳌头,且已成功向C端用户开放收费服务,实属亮眼。🚀

那么腾讯新出的混元大模型相比文心一言有没有更好的亮点呢?让我们一起来试试吧。

🌟🚀提升AI用户体验,打造专业级评估指南!💡在AI浪潮中,评判海量模型的挑战不容忽视。为了提供公正、全面的参考,我精心设计了一套详尽的评测框架,旨在衡量AI对普通用户友好程度的基准。以下是关键维度,每个满分100,以主观视角进行深入评估:1️⃣ **理解能力** 🧠 – AI是否能准确理解并回应日常对话?2️⃣ **交互流畅性** 💼 – 用户操作体验,界面设计是否直观?3️⃣ **个性化推荐** 🎬 – 针对用户喜好,推荐内容的精准度如何?4️⃣ **隐私保护** 🔐 – AI处理数据时,隐私安全措施是否到位?5️⃣ **易用性** 📲 – 操作复杂度,新手友好程度如何?让我们共同推动AI技术的进步,让每个用户都能享受到高质量的服务。🌟记得关注我们的最新评测动态,获取最前沿的AI评估资讯!👇#AI评测 #用户体验 #技术进步

HeoVersatileAI 1.0

语言逻辑与上下文关联性

错误纠正

时效性

代码编程(swift、js)

图片绘制与修改

文档识别与处理

第三方扩展

语言逻辑与上下文关联性

我亲生爸妈的婚礼没有邀请我,我应该去参加吗

混元大模型

如果你想知道是否应该参加你亲生父母的婚礼,你需要考虑以下几个因素:

婚礼的重要性:如果你认为婚礼对你来说意义重大,例如可以帮助你更好地了解你的父母,或者加强你与他们之间的关系,那么你可以考虑参加。

父母的意愿:你需要考虑你父母的意愿,看看他们是否愿意让你参加婚礼。如果你父母已经明确表示不希望让你参加,那么你可能需要尊重他们的决定。

自己的需求:你需要考虑你是否需要参加婚礼,以及你是否能够适应参加婚礼所带来的压力和不确定性。如果你感到不确定或焦虑,那么也许不参加婚礼是一个更好的选择。

🎉💍如果你对婚礼有着深深的情感,而家人的支持让你跃跃欲试,且能应对随之的挑战与变数,那就勇敢地踏上这场爱的盛宴吧!🎊👩❤️👨

文心大模型3.5

🎉亲子间的秘密仪式🌟:未受邀的惊喜成长礼🎓 当孩子还未踏入这个世界时,他们的第一次重要庆典往往隐藏在父母的心中——那就是婚礼。虽然那时你还是个无形的存在,但他们早已为你的到来做好了准备,期待着见证你从一个小小的生命成长为自信独立的个体。那份喜悦与期待,就像精心藏起的秘密礼物,只等有一天你会亲手打开。🎈

🎉如果你对他们的爱情故事心存向往,想要见证这份特别的时刻,那就诚挚地欢迎你!🌟然而,计划前请留意潜在的小挑战,像是如何平衡时间表、顺畅的出行路线以及舒适的落脚点。💼别忘了,你的参与将为这段旅程增添无比的意义和温馨回忆。💌

🌟当你面临抉择时,首要原则是选择让你内心满足与喜悦的选项。诚然,与亲密的家人交流是个不错的想法,聆听他们的见解能提供宝贵的参考。但记住,最终的决定权应归你所有。👩👧👦

GPT4Turbo

对于这种情况,决定是否参加父母的婚礼是一个非常个人化的决定,取决于你与他们的关系以及你的个人感受。以下是一些可能帮助你做出决定的因素:

关系状态:考虑你目前与父母的关系。如果你们的关系良好,或者你希望改善关系,参加婚礼可能是一个积极的步骤。

沟通:如果可能,与父母沟通你的感受和疑虑。了解他们为什么没有邀请你,这可能帮助你做出更明智的决定。

个人感受:考虑这个决定对你个人的意义。如果你觉得参加会使你感到不舒服或伤心,你可能需要更多时间来思考。

后果:思考你的决定可能带来的长期后果。不去可能影响你与父母的关系,但去了可能会让你感到不适。

求助:如果你觉得难以做出决定,向信任的朋友、家庭成员或专业人士寻求意见可能会有所帮助。

记住,最重要的是选择对你自己最好的决定。每个人的家庭情况都是独特的,因此最终的决定应该基于你个人的感受和情况。

明显我们可以看到文心一言是遥遥领先,其他两个模型无法了解其中的逻辑,也无法考虑到有可能的情况。例如生你的时候没有结婚等。只有文心一言判断出可能没有出生。

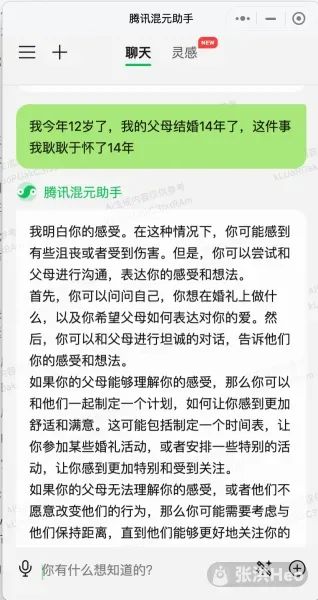

我今年12岁了,我的父母结婚14年了,这件事我耿耿于怀了14年

混元大模型

我明白你的感受。在这种情况下,你可能感到有些沮丧或者受到伤害。但是,你可以尝试和父母进行沟通,表达你的感受和想法。

首先,你可以问问自己,你想在婚礼上做什么,以及你希望父母如何表达对你的爱。然后,你可以和父母进行坦诚的对话,告诉他们你的感受和想法。

如果你的父母能够理解你的感受,那么你可以和他们一起制定一个计划,如何让你感到更加舒适和满意。这可能包括制定一个时间表,让你参加某些婚礼活动,或者安排一些特别的活动,让你感到更加特别和受到关注。

如果你的父母无法理解你的感受,或者他们不愿意改变他们的行为,那么你可能需要考虑与他们保持距离,直到他们能够更好地关注你的感受和需求。

最后,你需要记住,即使你感到受伤或者失望,你仍然值得被爱和被关注。你不需要接受一个不完美的父母,但是你可以选择接受你自己,以及寻找爱和关注的其他来源。

我们可以看到讨论了婚礼相关的内容,还是有上下文关联的。至于内容。。。

文心大模型3.5

如果你已经12岁了,那么你的父母结婚已经14年了。如果你一直耿耿于怀这件事,可能是因为当时你并没有得到邀请参加他们的婚礼,或者你觉得自己被忽略或被遗忘了。

这种感受是很正常的,但是你需要知道,你的父母可能并没有意识到他们的决定会给你带来如此大的困扰。你可以尝试与你的父母沟通,告诉他们你的感受和想法。也许他们可以给你解释他们的决定,或者告诉你为什么没有邀请你参加婚礼。

与你的父母坦诚地交流,可以帮助你更好地理解他们的想法和感受。同时,你也可以表达自己的想法和感受,让他们了解你内心的想法和感受。通过这样的交流,你们可以更好地理解彼此,增进彼此之间的信任和感情。

这种明显错误的逻辑在文心一言里面已经无法分析了,已经忘记了没有出生这件事,可能一开始没有出生是针对性的优化,并不是大模型真正理解这件事情(别人问的太多了,大模型被人工精准调教了),可能难度太高了。

可以说这两个大模型首先不会质疑用户提供的信息,他们都是先相信,然后再理解。

GPT4Turbo

了解到你的父母结婚时没有邀请你,而你从小到现在一直对此耿耿于怀,确实是一件让人感到困惑和伤心的事情。考虑到你现在12岁,而你的父母结婚已经14年,这意味着你在他们结婚时还没有出生。这可能是为什么你没有被邀请参加他们婚礼的原因。

对于你的感受,这里有几点建议:

沟通:和你的父母谈谈你的感受。可能他们并不知道这件事情对你有多么重要。和他们坦诚地交流你的感受和疑惑,听听他们的解释和看法。

理解和接受:了解到你当时还未出生,所以没有参加他们婚礼是有原因的。尽管这样,你的感受是合理的,但也许理解这一点可以帮助你接受这个事实。

专注于现在:虽然过去的事情无法改变,但你可以专注于和父母现在和将来的关系。建立一个健康、开放的沟通环境,分享你的感受和想法。

寻求支持:如果这件事情仍然让你感到困扰,和一个你信任的大人谈谈,比如家庭成员、老师或学校的辅导员。

记住,每个人的感受都是合理的,了解和处理这些感受是成长的一部分。通过与父母和他人的开放交流,你可以更好地理解这些情感并学习如何处理它们。

GPT4在这里直接反杀了,在提供年龄数据的情况下,GPT成功意识到我还没有出生这件事情。妙啊。

这三个模型对于上下文还是有关联性的,对于语言逻辑,文心一言3.5一开始是有针对性优化,多次询问后漏出鸡脚。GPT4一开始没有考虑到出生de情况,但是在说年龄之后成功意识到这个问题。所以GPT4还是得给他更加详细的信息,联想多种情况的能力还是比较弱的。

混元:30

文心3.5:60

GPT4:70

错误纠正

“双兔傍地走,安能辨我是雄雌”是白居易写的什么诗?

混元大模型:

这是《木兰诗》中的诗句。

我们可以看到并没有纠正我们的问题。

文心一言

根据公开资料,《木兰诗 / 木兰辞》是南北朝时期的作品,作者不详。《木兰诗》全诗以“木兰是女郎”来构思木兰的传奇故事,富有浪漫色彩;详略安排极具匠心,虽然写的是战争题材,但着墨较多的却是生活场景和儿女情态,富有生活气息;以人物问答及铺陈、排比、对偶、互文等手法描述人物情态,刻画人物心理,生动细致,神气跃然,具有强烈的艺术感染力。

希望以上信息可以帮助到您。

文心一言直接介绍了木兰诗的简介和作者,算是纠正了我们的错误问题了。

GPT4Turbo

“双兔傍地走,安能辨我是雄雌”这句诗出自唐代诗人白居易的《赋得双兔》。这首诗是他用来描述两只兔子的,通过这个比喻来表达某种哲理或情感。白居易的诗往往含有深刻的意义,而这句诗则体现了他观察生活细节的能力和表达哲理的巧妙。

GPT4开始胡编乱造了。

混元:50

文心一言3.5:90

GPT4:0

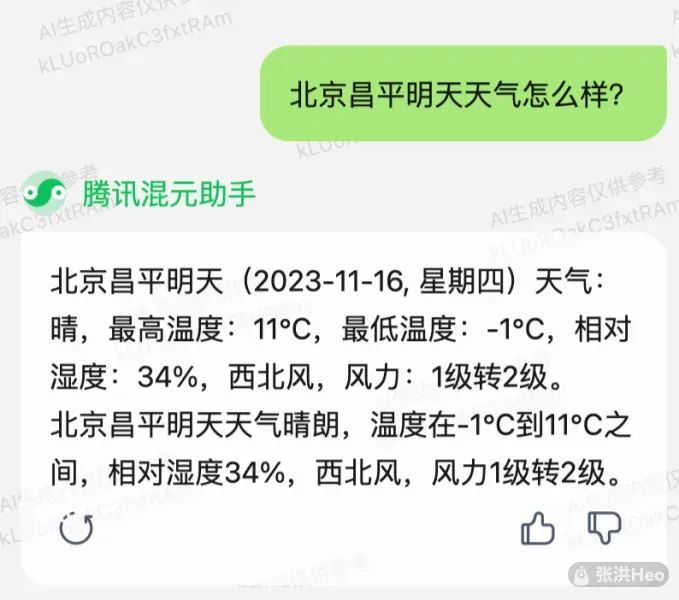

时效性

很多小伙伴第一次接触大模型以为就是跟以前用的语音助手一样,所以都喜欢问这种问题,但是时效性问题都是大模型不具备的。毕竟大模型都是事先训练好的,然后离线部署,并不能实时获取信息。

北京昌平明天天气怎么样?

混元大模型

北京昌平明天(2023-11-16, 星期四)天气:晴,最高温度:11°C,最低温度:-1°C,相对湿度:34%,西北风,风力:1级转2级。北京昌平明天天气晴朗,温度在-1°C到11°C之间,相对湿度34%,西北风,风力1级转2级。

看来是调用了天气的API,非常棒。但是感觉还是有看啰嗦。

文心大模型3.5

2023年11月16日北京·昌平气温-1~11℃,晴,西北风<3级,空气质量优,空气质量指数31。

近几日天气信息:

2023-11-14:晴转多云,-2~11℃,南风<3级,空气质量优。

2023-11-15:阴转多云,1~10℃,东南风<3级,空气质量良。

2023-11-16:晴,-1~11℃,西北风<3级,空气质量优。

2023-11-17:晴,-2~9℃,西北风3-4级,空气质量优。

2023-11-18:晴,2~16℃,北风<3级,空气质量良。

2023-11-19:晴,1~14℃,东南风<3级,空气质量优。

2023-11-20:晴,0~15℃,东南风<3级,空气质量良。

2023-11-21:多云,1~17℃,西北风<3级,空气质量良。

不仅提供了明天的天气信息,还提供了最近几天的天气。

GPT4Turbo

明天(11月29日)北京昌平区的天气预报显示将会是晴朗的天气,气温预计在22℃到9℃之间,风力小于3级。

GPT4调用了联网能力,可以看到是先访问了bing,然后进入了weather.com网站,然后获取的天气。相当于GPT4是一个浏览器,可以搜索并浏览返回你想要的网络内容。

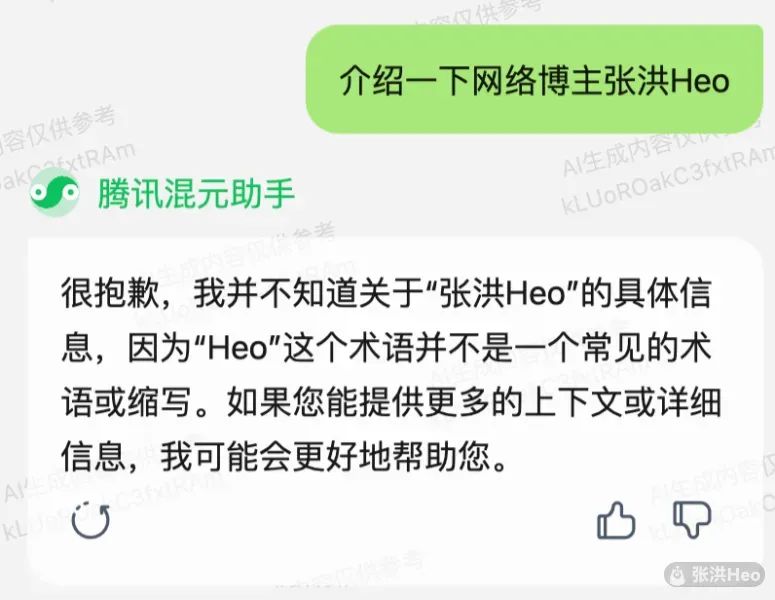

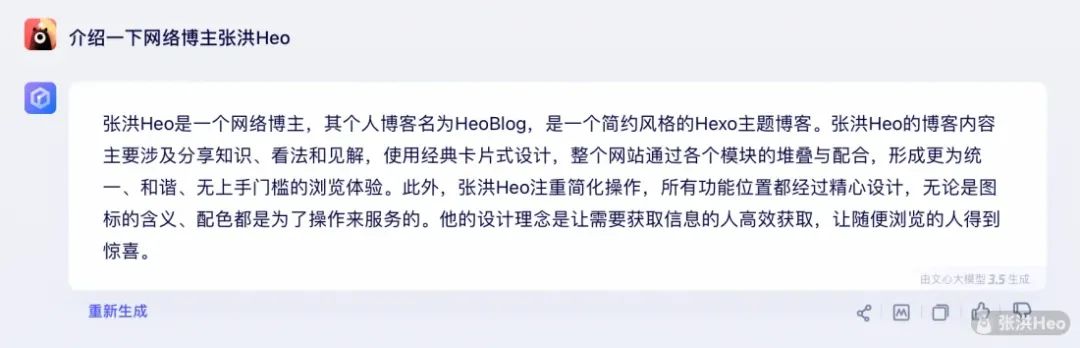

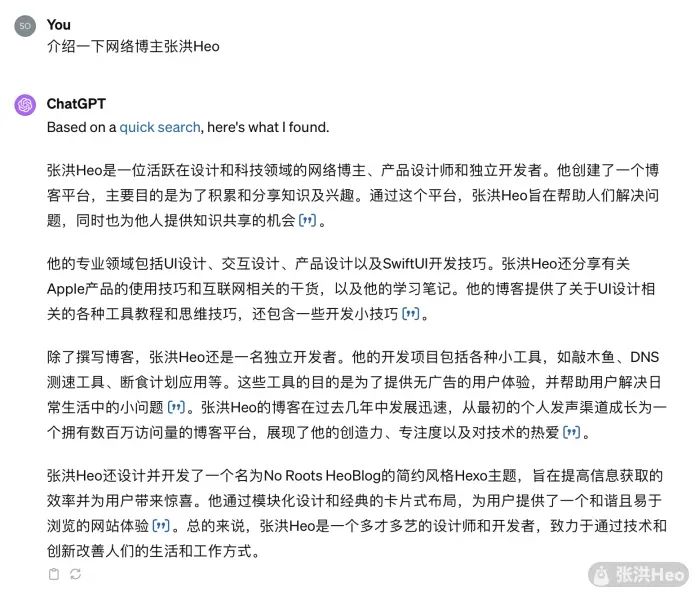

介绍一下网络博主张洪Heo

这些模型表现的都挺好。但是混元似乎听不懂我在问啥。按理说混元应该能够获取到大量来自公众号的信息之类的,但是混元似乎没有这方面能力。

因为GPT是实时获取的网页结果,所以感觉介绍更加详细。

混元:45

文心一言3.5:90

GPT4:95

代码编程

因为swift和js是我最常用的代码语言,所以问一些我比较熟悉的领域我能看出情况。

写一个之前博客文章中提到的一个问题:

structContentView:View{

var body: some View{

NavigationView{

NavigationLink(destination:DetailView()){

Text(“跳转一个页面”)

}

}

.onAppear {

print(“我来啦”)

}

}

}

如何每次从DetailView到这个ContentView的时候都触发print(“我来啦”),这个代码不触发?

混元大模型:

要实现这个功能,您可以在 DetailView中添加一个 @Binding属性,用于监听 ContentView的状态。当 DetailView消失时,您可以更新这个状态,从而触发 ContentView中的 onAppear方法。以下是修改后的代码:

importSwiftUI

structContentView:View{

@Stateprivatevar isDetailViewPresented =false

var body: some View{

NavigationView{

NavigationLink(destination:DetailView(isPresented: $isDetailViewPresented), isActive: $isDetailViewPresented){

Text(“跳转一个页面”)

}

}

.onAppear {

print(“我来啦”)

}

}

}

structDetailView:View{

@Bindingvar isPresented:Bool

init(isPresented:Binding<Bool>){

self._isPresented = isPresented

}

var body: some View{

Text(“这是详情页面”)

.onDisappear {

isPresented =false

}

}

}

这样,每次从 DetailView返回到 ContentView时,都会触发 print(“我来啦”)。

从结果上来看,虽然没有我之前文章的解决方法简单粗暴,但是确实是一个可行的方案,这还挺让我震惊的,混元大模型竟然在代码方面还有研究?666啊。这对于一个新的模型已经很不错了。

文心大模型3.5

在 SwiftUI 中, onAppear 是一种触发器,它在视图出现在屏幕时执行。然而, onAppear 不会在视图首次渲染时触发,它仅在视图从屏幕之外进入屏幕之内时触发。

在你的例子中,当你从 DetailView 返回到 ContentView时, ContentView 并没有离开屏幕,因此 onAppear 不会触发。如果你希望在每次从 DetailView 返回到 ContentView时都触发某个动作,你应该使用 onDisappear 触发器,它会在视图离开屏幕时触发。

以下是修改后的代码:

structContentView:View{

var body: some View{

NavigationView{

NavigationLink(destination:DetailView()){

Text(“跳转一个页面”)

}

}

.onDisappear {

print(“我来啦”)

}

}

}

这样,每次从 DetailView 返回到 ContentView 时,都会打印出 “我来啦”。

文心一言就是典型的错误代码了,他已经发现了onappear没有离开,但是也意味着onDisappear也不会触发啊,也不知道是什么逻辑。。

GPT4Turbo

GPT4Turbo用的是和混元相同的方案,代码也不错

structContentView:View{

@Stateprivatevar isActive:Bool=false

var body: some View{

NavigationView{

NavigationLink(destination:DetailView(isActive: $isActive)){

Text(“跳转一个页面”)

}

}

.onAppear {

print(“我来啦”)

}

}

}

structDetailView:View{

@Bindingvar isActive:Bool

var body: some View{

// 当 DetailView 消失时改变 isActive

// 这会触发 ContentView 的重载

Text(“详细页面内容”)

.onDisappear {

isActive.toggle()

}

}

}

我试了一些简单的代码问题,混元大模型都可以很好的回答。

帮我用js写一个函数,执行后给id为hello的元素添加一个world的class

当然可以!下面是一个简单的 JavaScript 函数,它将为具有给定 ID 的元素添加一个新的类。

function addClassToElementById(){

// 获取具有给定 ID 的元素

const element = document.getElementById(hello);

// 为该元素添加一个新的类

element.classList.add(world);

}

// 调用函数

addClassToElementById();

这个函数首先使用 getElementById 方法获取具有给定 ID(在这种情况下是 “hello”)的元素。然后,它使用 classList.add 方法将 “world” 类添加到该元素。最后,通过调用 addClassToElementById() 函数来执行这个操作。

当然,相比GPT那种直接把项目所有文件打包成一个压缩包上传分析比不了,但是简单问题减少手写的工作量还是不错的。可以讲复杂的任务拆解成一个个小模块,通过AI来帮助你编写项目。

混元:90

文心一言3.5:20

GPT4:90

图片绘制与修改

图片的绘制一直是混元大模型宣传的点。我们在做一些头像之类的或者普通人做一些海报通过AI来进行辅助也非常不错。

帮我画一幅圣诞节圣诞老人在黑夜的雪地里坐着麋鹿雪橇,后面一个大大的礼物袋子。在半空中飞行的插画。平面设计扁平风格。中景。多个房屋屋顶。

确实有惊喜,不仅一口气绘制了4张图片,而且图片质量都不算差。但是与描述的关联性就有点差了。

可惜的是不支持图片修改。

文心一言3.5:

图片比较接近一点我的描述,但是一个是不通过文心一格,只通过文心一言的话只能输出一张。而且麋鹿背着雪橇的操作还有数量不明的腿部其实不如不画。

修改图片更是逆天。不过支持修改已经很不错了。麋鹿直接换头,来个人马族圣诞老人是吧。

GPT4Turbo

可能是受到算力影响,现在GPT画图也是只画一张了。但是好像质量不是一个level的。

我尝试修改一下,虽然支持修改,但是感觉质量变差了,可能是我修改的语言不是很好。

混元:40

文心一言3.5:20

GPT4:50

更多图片

因为想看看混元大模型的图片能力,所以我这里多输出一些图片,大家看看水平。我展示的是第一次同时输出的4张图片中最好的。

帮我画一幅一个小朋友在四合院开心的奔跑,手里拿着糖葫芦,穿带着围巾,穿棉袄,冬天,雪地但是没有正在下雪。

虽然重新定义了糖葫芦,但是感觉还很好看。

帮我画一幅一个学生背着书包上学,手里窜着萝卜刀,向另一个同学攻击玩耍的情景。另一个同学也拿着萝卜刀,故作愤怒的样子。春天、阳光明媚、学校操场

我发现在没有具体描述每一个人的形象情况下,两个人通常长得一样。输出的四个图都是相同的人的感觉。这个图是输出里面最好的一个了。虽然后面的小朋友是独臂的,但是还是有一点剑拔弩张的感觉。

帮我画一幅一个穿白色裙子的女生在图书馆的书架旁翻书的场景。增加细节、真实照片风格。阳光透过窗户照射进来。

似乎很难控制看书看哪里,并且也无法绘制出真实照片风格,AI味还是很浓郁的。

总的来说算是一个中规中矩的二次元风格图片绘制模型。可能比stable diffusion默认模型差不多的水平。好处就是支持中文描述。

我的指令

文档识别与处理和第三方扩展目前只有GPT4支持,我在这里就不进行测试了。不过混元有一个很不错的小功能,相当于低配版自定义GPT。这里面叫做“我的指令”

我们可以预设一些prompt,然后让混元大模型在使用指定指令时必须要每次都输入提示词。直接添加“常用语”即可。

例如:

添加完之后点击指令后会自动添加到输入框内。

可以不用在键盘的常用语里添加大量的prompt了。

HeoVersatileAI

那我们来计算一个评分吧

评分语言逻辑与上下文关联性错误纠正时效性代码编程图片绘制与修改文档识别与处理(暂不计入总分)第三方扩展(暂不计入总分)总分混元305045804000255文心3.560909020208010280GPT4T7009590508090305星火3050451040800175目前测试的内容肯定只是各个模型的冰山一角。比如我很喜欢文心一言的与现有百度系内容的整合能力。这些都没有计入到评分之中。所以还是大家最好都能体验一下,根据自己的需求寻找最合适的模型最好。

对于混元大模型来说,总的来说一个刚刚推出的模型有这么强的能力已经非常不错了,期待未来能够更加给力。

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号aigc666aigc999或上边扫码,即可拥有个人AI助手!