文章主题:百川智能, 预训练大模型, 中文表现, 英文表现

在2023年的6月15日,我国知名的人工智能企业百川智能公司发布了一款具有重大影响力的新产品——baichuan-7B,这是一款拥有70亿个参数的中英文预训练大模型。令人瞩目的是,baichuan-7B在多个重要的评测榜单上,如C-Eval、AGIEval以及Gaokao中文权威评测榜单中,都展现出了超越其他大模型的显著优势,尤其在MMLU英文权威评测榜单上,它更是大幅度领先于LLaMA-7B。这一成果充分展示了我国人工智能技术的先进性和强大实力。

当前,我国自主研发的 Baichuan-7B 大模型已成功在 Hugging Face、Github 和 Model Scope 等平台上正式上线。

开源地址:

Hugging Face:https://huggingface.co/baichuan-inc/baichuan-7B

Github:https://github.com/baichuan-inc/baichuan-7B

Model Scope:https://modelscope.cn/models/baichuan-inc/baichuan-7B/summary

多个最具影响力中文评估基准7B最佳

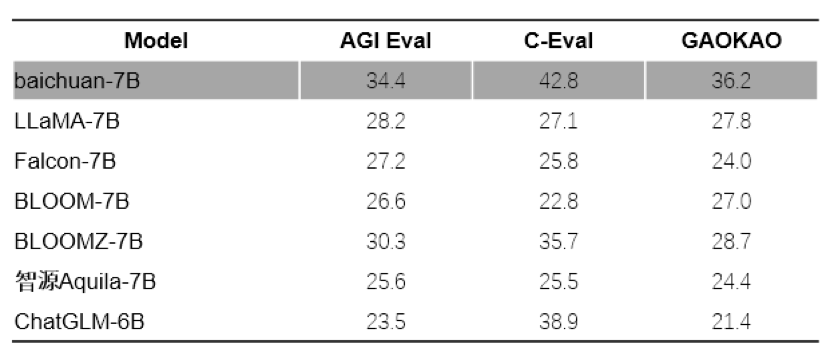

为确认模型的全面性能,我国自主研发的baichuan-7B模型在C-Eval、AGIEval和Gaokao三个具有最高影响力的中文评估基准上进行了综合性评估,并取得了卓越的成绩。由此,baichuan-7B成功树立了在同等参数规模下,中文表现最为出色的原生预训练模型的地位。

在我国进行的中文C-EVAL评测中,模型baichuan-7B的综合评分达到了令人瞩目的42.8分,这一成绩甚至超越了同样拥有较高综合评分的ChatGLM-6B(38.9分)。此外,baichuan-7B的表现甚至超过了部分参数规模更大的竞争对手。

https://cevalbenchmark.com/static/leaderboard_zh.html (时间为2023-06-15)

C-Eval评估基准是由上海交通大学、清华大学与爱丁堡大学联手创立的,这是一个专门针对中文语言模型进行综合评估的测试集。该基准涵盖了52个来自不同行业领域的学科,从而为评估者提供了丰富的数据来源和全面的参考依据。

在AGIEval评测中,baichuan-7B模型的综合评分达到了令人瞩目的34.4分,这一成绩远远超过了其他知名的开源模型,如LLaMa-7B、Falcon-7B、Bloom-7B和ChatGLM-6B等。这充分展示了baichuan-7B模型在自然语言处理领域的强大实力和优秀表现。

AGIEval评估基准是由微软研究院倡导并实施的,其目的是全面而深入地衡量基础模型在人类认知及问题解决相关任务上的表现。该基准涵盖了我国的高考、司法考试,同时也包括美国的高考(SAT)、法律专业入学考试(LSAT)、研究生入学考试(GRE)以及和管理专业入学考试(GMAT)等20个经过严格审查并且公开的官方入学和职业资格考试。

在GAOKAO评测中,baichuan-7B模型综合得分高达36.2分,这一成绩远超同参数规模的其他预训练模型,充分展现了其卓越的性能优势。

GAOKAO评测基准是复旦大学研究团队创建的评测框架,以中国高考题目作为数据集,用于测试大模型在中文语言理解和逻辑推理能力方面的表现。

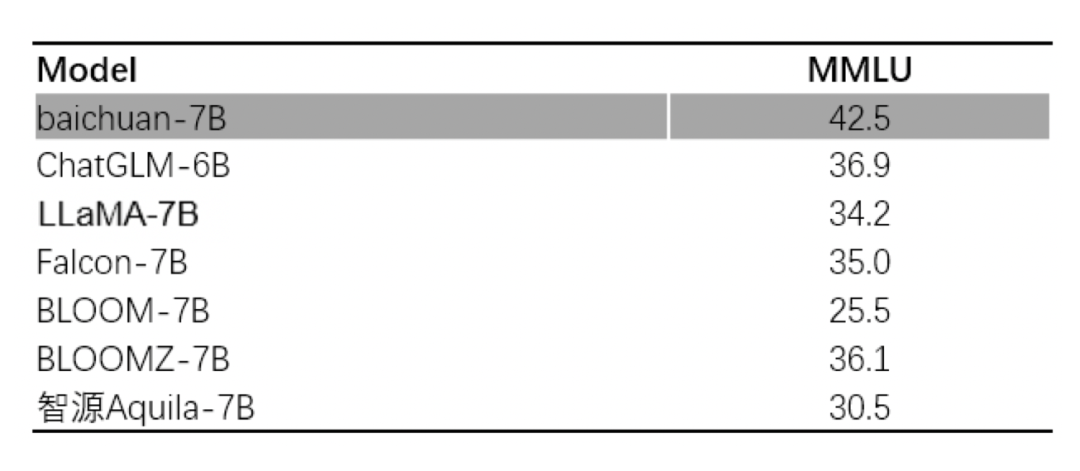

MMLU英文评估基准表现大幅领先LLaMA-7B

baichuan-7B不仅在中文方面表现优异,在英文上表现同样亮眼。在MMLU的评测中baichuan-7B综合评分高达42.5分,大幅领先英文开源预训练模型LLaMA-7B的34.2分以及中文开源模型ChatGLM-6B的36.9分。

MMLU由加州大学伯克利分校等知名高校共同打造,集合了科学、工程、数学、人文、社会科学等领域的57个科目,主要目标是对模型的英文跨学科专业能力进行深入测试。其内容广泛,从初级水平一直涵盖到高级专业水平。

万亿优质数据、4K上下文窗口、高效稳定训练造就领先7B预训练模型

训练语料对大模型的训练结果至关重要。在构建预训练语料库方面,百川智能以高质量中文语料为基础,同时融合了优质的英文数据。在数据质量方面,通过质量模型对数据进行打分,对原始数据集进行篇章级和句子级的精确筛选;在内容多样性方面,利用自研超大规模局部敏感哈希聚类系统和语义聚类系统,对数据进行了多层次多粒度的聚类,最终构建了包含1.2万亿token的兼顾质量和多样性的预训练数据。相较于其他同参数规模的开源中文预训练模型,数据量提高了超过50%。

在万亿优质中英文数据的基础上,为了更好地提升训练效率,baichuan-7B深度整合了模型算子来加快计算流程,并针对任务负载和集群配置,自适应优化了模型并行策略以及重计算策略。通过高效的训练过程调度通信,baichuan-7B成功地实现了计算与通信的高效重叠,进而达到了超线性的训练加速,在千卡集群上训练吞吐达到180+Tflops的业界领先水平。

同时,已有的开源模型窗口长度在2K以内,对于一些长文本建模任务,如需要引入外部知识做搜索增强的场景,更长的处理长度有助于模型在训练与推理阶段捕获越多的上下文信息,2K的处理长度存在比较大的制约。baichuan-7B基于高效的attention算子优化实现了万级别超长动态窗口的扩张能力,本次开源的预训练模型开放了4K上下文窗口,使模型应用场景更加广泛。

此外,baichuan-7B还对模型训练流程进行了深度优化,采用了更科学且稳定的训练流程和超参数选择,使得 baichuan-7B模型的收敛速度大大提升。与同等参数规模的模型相比,baichuan-7B在困惑度(PPL)和训练损失(training loss)等关键性能指标上表现更加优秀。

免费可商用,清华北大率先使用助力研究

秉持开源精神,baichuan-7B代码采用Apache-2.0协议,模型权重采用了免费商用协议,只需进行简单登记即可免费商用。

baichuan-7B此次开源的内容十分丰富,包含了推理代码、INT4量化实现、微调代码,以及预训练模型的权重。其中,微调代码方便用户对模型进行调整和优化;推理代码与INT4量化实现则有助于开发者低成本地进行模型的部署和应用;预训练模型权重开源后,用户则可以直接使用预训练模型进行各种实验研究。

据了解,北京大学和清华大学两所顶尖大学已率先使用baichuan-7B模型推进相关研究工作,并计划在未来与百川智能深入合作,共同推动baichuan-7B模型的应用和发展。

清华大学互联网司法研究院院长、计算机系教授刘奕群认为, baichuan-7B模型在中文上的效果表现十分出色,它免费商用的开源方式展现出开放的态度,不仅贡献社区,也推动技术发展。团队计划基于baichuan-7B模型开展司法人工智能领域的相关研究。

北京大学人工智能研究院助理教授杨耀东认为,baichuan-7B模型的开源将对于中文基础语言模型的生态建设及学术研究产生重要推动作用,同时他也表示将持续关注相关领域探索,并且在中文大语言模型的安全和对齐上进行进一步深入研究。

百川智能CEO王小川表示:“本次开源模型的发布是百川智能成立2个月后的第一个里程碑,对百川智能而言是一个良好的开局。baichuan-7B模型,不仅能为中国的AGI事业添砖加瓦,也为世界大模型开源社区贡献了新的力量。”

百川智能, 预训练大模型, 中文表现, 英文表现

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号aigc666aigc999或上边扫码,即可拥有个人AI助手!