文章主题:科技企业, ChatGPT, 大模型行业, 开源

自去年12月ChatGPT热潮席卷全球以来,众多科技企业纷纷抓住这一机遇。历经半年多的狂热之后,大模型行业迎来了一个新的浪潮,即从闭源向开源的转变。

在今年7月19日,美国互联网巨头Meta推出了LLaMA2,引起了全球的热议。外界普遍认为,LLaMA2的开源版本可能会对大模型的未来发展产生深远影响。然而,在百川智能的创始人兼CEO王小川看来,他们刚刚推出的Baichuan 2系列开源大模型,已经在性能上全面超越了LLaMA2。

DoNews摄

在北京时间的9月6日,我国知名的人工智能公司——百川智能,举办了一场以“百川汇海,开源共赢”为主题的大型发布会。在发布会上,百川智能做出了一项重大决策,那就是正式将经过微调的Baichuan2-7B、Baichuan2-13B、Baichuan2-13B-Chat以及其4bit量化版本开源,并且所有这些资源都将对外免费开放,供所有人使用。这一举措无疑将极大地推动人工智能领域的发展,同时也是对开源精神的一种践行。

在百川智能发布会上,澜舟科技创始人兼CEO周明揭示了自己对于大模型创业的看法。他表示,虽然海外的开源模型主要支持英文等西方语言,但对于中文的支持却存在不足或者不够友好的情况。然而,Baichuan2的两款模型却展现出了对中文用户的高度友好性,同时在性能上超越了许多英文的同等规模模型。这无疑为中国大模型领域的研究和应用带来了巨大的利益。

在今年四月份,知名人工智能专家王小川在离开搜狗仅仅一年半之后,便创立了名为“百川智能”的企业。这家成立时间尚不足半年的公司,其在大模型产业领域的发展潜力引发了业界的高度关注。

文理兼备,性能超越LLaMA2

据了解,在新的模型上,百川智能的研究者们从数据获取到微调进行了很多优化。

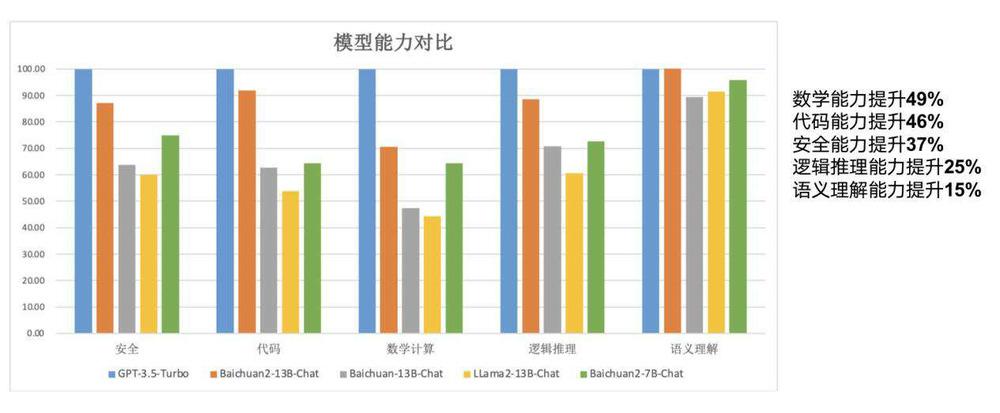

本文将深入探讨Baichuan2-7B-Base和Baichuan2-13B-Base这两个模型,它们都是基于2.6万亿高质量多语言数据进行训练的。这两个模型在保留上一代开源模型的生成与创作能力、多轮对话能力以及部署门槛较低等众多特性的基础上,实现了数学、代码、安全、逻辑推理和语义理解等能力的显著提升。特别是,Baichuan2-13B-Base相较于上一代的13B模型,在数学、代码、安全、逻辑推理和语义理解等方面都有明显进步。具体来说,数学能力提升了49%,代码能力提升了46%,安全能力提升了37%,逻辑推理能力提升了25%,而语义理解能力则提升了15%。这些提升不仅展示了这些模型的强大能力,也预示着它们在未来可能发挥更大的作用。

DoNews摄

在进行搜索任务的过程中,我们积累了许多宝贵的经验。这些经验使我们能够对大量的模型训练数据进行多粒度的内容质量评分。为了提高模型的表现,我们使用了2.6亿级的语料库来训练7B和13B的模型,并成功加入了多语言支持。王小川透露,我们的千卡A800集群可以实现180TFLOPS的训练性能,同时机器利用率超过了50%。除此之外,我们还致力于完成各种安全对齐的工作,以期进一步提高模型性能和稳定性。

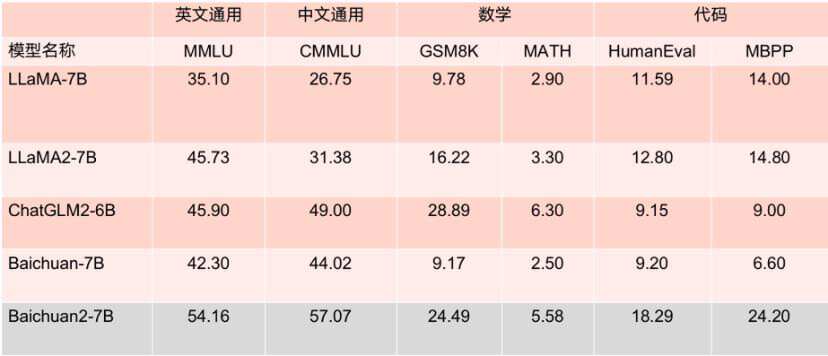

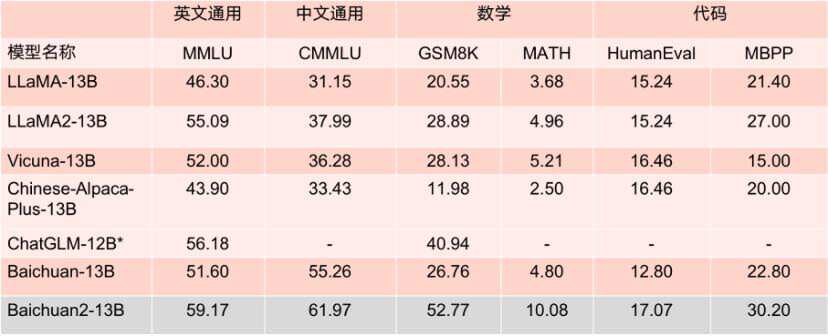

在本次开源的模型中,我们在多个评测榜单上取得了优异的成绩,其中包括MMLU、CMMLU、GSM8K等权威评估基准。相较于其他同等参数量的模型,我们的模型在表现上有着显著的优势,特别是在LLaMA2方面,其表现相当出色,远超同类竞品。这充分展示了我们模型的强大实力和优越性能。

更值得一提的是,根据 MMLU 等多个权威英文评估基准评分 Baichuan2-7B 以 70 亿的参数在英文主流任务上与 130 亿参数量的 LLaMA2 持平。

百川供图

值得一提的是,根据MMLU等多个权威英文评估基准评分Baichuan2-7B以70亿的参数在英文主流任务上与130亿参数量的LLaMA2持平。

7B参数模型的Benchmark成绩 百川供图

13B参数模型的Benchmark成绩 百川供图

Baichuan2-7B和Baichuan2-13B不仅对学术研究完全开放,开发者也仅需邮件申请获得官方商用许可后,即可以免费商用。

全程开源模型训练Check Point,助力学术研究

大模型训练包含海量高质量数据获取、大规模训练集群稳定训练、模型算法调优等多个环节。每个环节都需要大量人才、算力等资源的投入,从零到一完整训练一个模型的高昂成本,阻碍了学术界对大模型训练的深入研究。

本着协作和持续改进的精神,百川智能本次开源了模型训练从220B到2640B全过程的 Check Ponit。这对于科研机构研究大模型训练过程、模型继续训练和模型的价值观对齐等极具价值,将极大推动国内大模型的科研进展,开源训练模型过程对国内开源生态尚属首次。

百川供图

值得一提的是,在大会现场,中国科学院院士、清华大学人工智能研究院名誉院长张钹对大模型发展提出了自己的看法。张钹认为,虽然大模型行业取得了广泛关注,但是“大模型产生”的现象仍然缺乏可解释性。

到现在为止,全世界对大模型的理论工作原理、所产生的现象都是一头雾水,所有的结论都推导产生了「涌现现象」,所谓「涌现」,就是给自己一个退路,解释不清楚的情况下就说它是涌现,实际上这反映了我们对它一点不清楚。

张钹表示,对于模型的训练与推理的过程,仍然是人工智能学术领域需要不断去探索的课题。到现在为止国内的大模型主要集中在垂直领域的应用上,因此,他很支持百川智能把这次的开源模型定位在助力学术研究上。

张钹院士 百川供图

技术报告揭示训练细节,繁荣开源生态

当前大部分开源模型在开源过程中只是对外公开自身的模型权重,很少提及训练细节,企业、研究机构、开发者们只能在开源模型的基础上做有限的微调,很难进行深入研究。

百川智能在发布会上宣布,公开Baichuan 2的技术报告。技术报告将详细介绍Baichuan 2 训练的全过程,包括数据处理、模型结构优化、Scaling law、过程指标等。

王小川表示,“这对于大家理解预训练,或者进行微调强化能够带来帮助。这也是在国内首次有公司能开放这样的训练过程。”

百川供图

百川智能自成立之初,就将通过开源方式助力中国大模型生态繁荣作为公司的重要发展方向。成立不到四个月,便相继发布了 Baichuan-7B、Baichuan-13B 两款开源免费可商用的中文大模型,以及一款搜索增强大模型 Baichuan-53B,两款开源大模型在多个权威评测榜单均名列前茅,目前下载量超过 500 万次。

不仅如此,在今年创立的大模型公司中,百川智能是唯一一家通过《生成式人工智能服务管理暂行办法》备案,可以正式面向公众提供服务的企业。凭借行业领先的基础大模型研发和创新能力,此次开源的两款Baichuan 2大模型,得到了上下游企业的积极响应,腾讯云、阿里云、火山方舟、华为、联发科等众多企业均参加了本次发布会并与百川智能达成了合作。

未来,百川智能将在开源大模型领域持续深耕,将更多的技术能力、前沿创新开放出来,与更多的合作伙伴们共同助力中国大模型生态发展。

科技企业, ChatGPT, 大模型行业, 开源

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号aigc666aigc999或上边扫码,即可拥有个人AI助手!