文章主题:

当前,越来越多的开发者投入到大模型开发中,其中面临一个比较大的痛点就是如何让模型运行在本地电脑上,这通常来自两个使用场景,一是方便在离线状态下进行大模型应用开发调试,另一个是能够开发一些不依赖于网络的本地化大模型应用。当前比较出名的有两个产品Ollama和LMstudio。

Ollama

ollama是笔者很看好的一个开源项目,它的理念比较新颖,对于熟悉docker的开发者能够很自然的上手,在之前探秘大模型应用开发中就对其做了介绍,延伸阅读:一文探秘LLM应用开发(17)-模型部署与推理(框架工具-ggml、mlc-llm、ollama)。该项目发展迅速,之前笔者发稿时还是个小众项目,现在已经成为开发者主流本地运行时,斩获46k star,社区生态活跃,基本上一有新的模型发布,就有开发者第一时间为ollama适配。

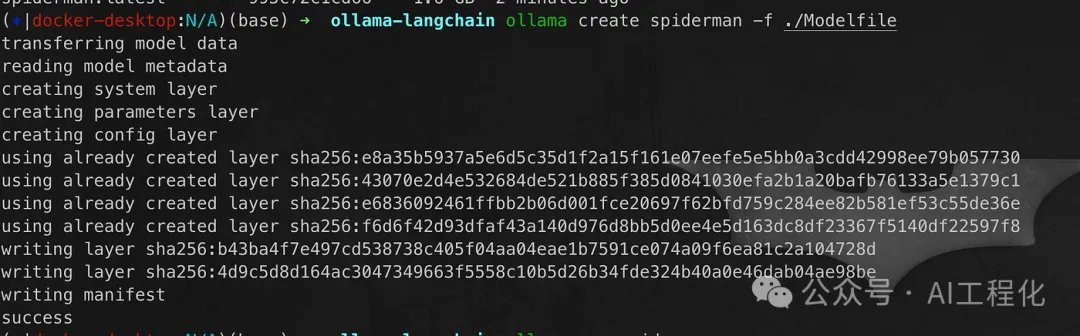

下面是简单的使用过程:1)制作模型文件,类似于dockerfile。

2)可查看本地托管的模型。类似于docker images。

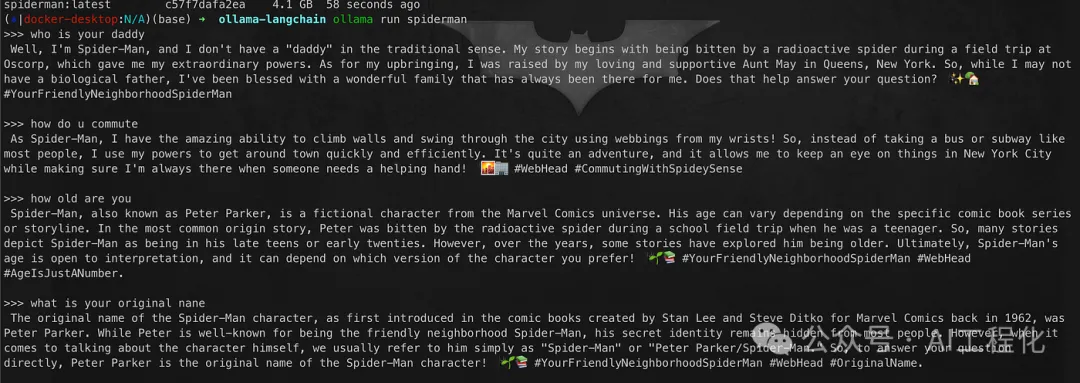

3)运行本地模型。

优势

劣势

适用场景

Ollama

– 提供了一系列广泛的预训练模型:由于模型种类和构架的多样性,用户能根据其需求挑选到最合适的模型。– 灵活的微调选择:用户可以利用自定义数据集对预训练模型进行微调,使其更适合特定的任务和领域,加快原型的研制和实验。– 便捷的协作功能:Ollama 支持团队成员之间合作,能够无缝地共享模型、数据集和实验成果。– 定制选项有限:虽有多个预训练模型可供选择,但用户可能会在模型架构或训练模式的个性化上有所局限。– 成本问题:根据使用量和资源需求的不同,使用 Ollama 的成本也会出现变化,因此在价格上需要精心评估以保证性价比。适合习惯使用命令行界面的开发者和技术熟练者的理想选择,是探索不同大型语言模型和微调特殊任务模型的完美工具。LMstudio– 先进的模型训练功能:它允许广泛定制模型训练,包括支持分布式训练、调整超参数以及模型优化,使用户能够获得行业领先水平的性能。– 易扩展和高效表现:LM Studio 设计用来高效地处理大规模模型训练和部署工作,能够利用云基础设施和并行处理技术,加速模型训练和处理速度。– 与云服务的无缝整合:LM Studio 可以轻松地与各种云服务和平台整合,让用户在模型的开发和部署上拥有更多资源和功能。– 完全掌握较难:因为拥有大量高级功能和强大能力,虽然上手容易,但要完全精通很难。– 资源要求高:在 LM Studio 构建和训练复杂模型可能需要颇多的计算资源和专业技能,对于难以获得高性能计算设备的用户来说可能是一个障碍。对包括非技术用户在内的所有人使用都更为简单,提供了一个可视化界面帮助管理模型、任务和结果输出。特别适用于创意写作、生成不同文本格式和探索模型的多元特性。结论:

在选择 Ollama 和 LM Studio 时,应根据专业技能、预算和具体需求来判断。

– 对于开发者:Ollama 开放源代码的特性、效率高和可定制化性使其成为尝试和微调创意的理想选项。

– 对于初学者和普通用户:LM Studio 的用户友好界面、预训练模型和多样的功能提供了一个基础起点,适合进行创意性探索和多样化文本生成。

欢迎点赞加关注,并可在公众号内回复”进群”可进群交流。

AI时代,掌握AI大模型第一手资讯!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

扫码右边公众号,驾驭AI生产力!