文章主题:稳定视频扩散, AI 视频生成, Stable AI, 图像到视频模型

Stable Video Diffusion来了,代码权重已上线

机器之心报道

机器之心编辑部

Stability AI 的视频生成模型看来效果不错。AI 画图的著名公司 Stability AI,终于入局 AI 生成视频了。

本周二,备受瞩目的基于Stable Diffusion的视频生成模型Stable Video Diffusion正式亮相,这无疑为AI领域带来了巨大的震撼。人们纷纷开始讨论和探讨这一创新技术,它将为视频生成领域带来全新的变革。

很多人都表示「我们终于等到了」。

项目链接:https://github.com/Stability-AI/generative-models

现在,你可以基于原有的静止图像来生成一段几秒钟的视频。

基于稳定性人工智能(Stability AI)所取得的稳定性扩散文本生成模型(Stable Diffusion)的成功,使得其视频扩散生成模型(Stable Video Diffusion)在开源领域或商业市场上成为极少数的视频生成模型之一。

然而,目前并非所有人都能够实际应用,Stable Video Diffusion 尚未向公众开放。不过,我们已启动用户候补名单的注册工作,以便在适当的时机邀请更多用户加入我们的平台。

https://stability.ai/contact)。

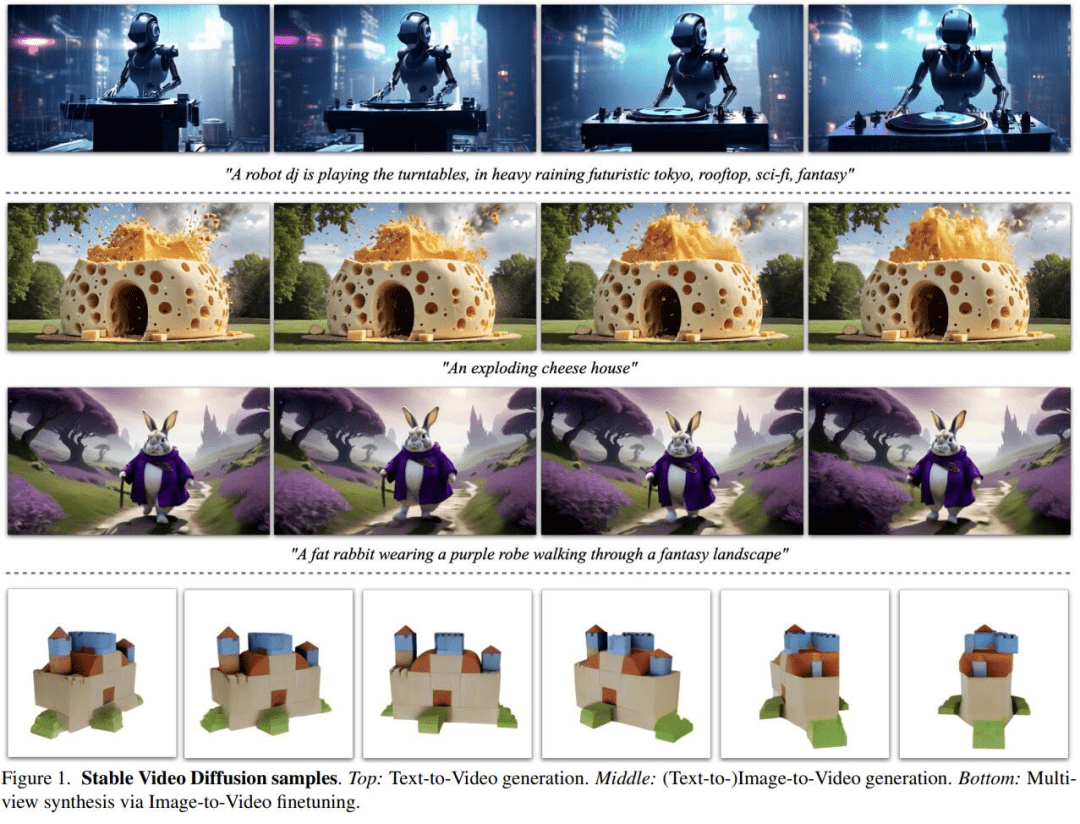

Stable Video Diffusion 是一种具有强大功能的深度学习技术,能够轻松应对多种下游任务。据相关介绍,该技术可以通过对多视图数据集进行微调,从而实现从单一图像到多视图合成的目的。稳定性人工智能公司(Stability AI)透露,他们正积极筹备并拓展基于稳定扩散原理的各种模型,旨在构建一个类似 stable diffusion 生态系统的全方位解决方案。

Stable Video Diffusion 是一种具有高度稳定性的视频扩散技术,它能够将两种图像转化为视频模型,并以每秒 3 到 30 帧的可定制帧速率生成 14 和 25 帧的视频。这种技术的优势在于其灵活性和广泛的应用场景,可以满足不同用户对于视频质量的要求,同时也能够有效地提高生产效率。

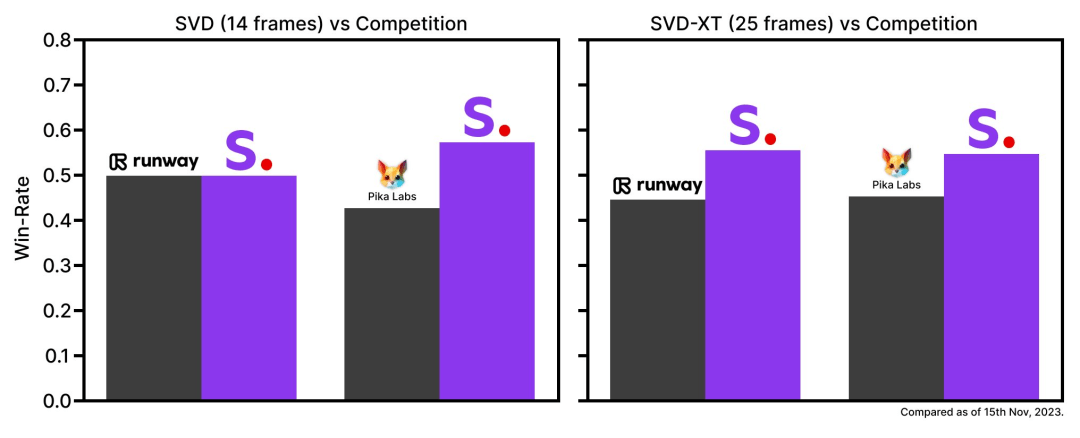

在外部评估中,Stability AI 证实这些模型超越了用户偏好研究中领先的闭源模型:

Stability AI 强调,Stable Video Diffusion 目前并不适合在现实世界或商业领域中直接应用。不过,我们会根据用户对于安全和质量的反馈,持续优化和完善这个模型。

在本文中,我们将探讨稳定视频扩散在大型数据集上的应用。为了实现这一目标,我们首先研究了稳定视频扩散的基本原理,并对其进行了改进,使其能够更好地适应大型数据集。在此基础上,我们构建了一种新的模型,将其应用于大型数据集的训练和推理过程中。实验结果表明,我们的方法在许多指标上均取得了显著的提升,为未来相关领域的研究奠定了坚实的基础。具体而言,我们的研究成果已发表在论文《Stable Video Diffusion: Scaling Latent Video Diffusion Models to Large Datasets》中,并提供了一个公开的链接:https://stability.ai/research/stable-video-diffusion-scaling-latent-video-diffusion-models-to-large-datasets。

Stable Video Diffusion 是 Stability AI 各式各样的开源模型大家族中的一员。现在看来,他们的产品已经横跨图像、语言、音频、三维和代码等多种模态,这是他们致力于提升 AI 最好的证明。

Stable Video Diffusion 的技术层面

Stable Video Diffusion 作为一种高分辨率的视频潜在扩散模型,达到了文本到视频或图像到视频的 SOTA 水平。近期,通过插入时间层并在小型高质量视频数据集上进行微调,为 2D 图像合成训练的潜在扩散模型已转变为生成视频模型。然而,文献中的训练方法千差万别,该领域尚未就视频数据整理的统一策略达成一致。

在 Stable Video Diffusion 的论文中,Stability AI 确定并评估了成功训练视频潜在扩散模型的三个不同阶段:文本到图像预训练、视频预训练和高质量视频微调。他们还证明了精心准备的预训练数据集对于生成高质量视频的重要性,并介绍了训练出一个强大基础模型的系统化策划流程,其中包括了字幕和过滤策略。

Stability AI 在论文中还探讨了在高质量数据上对基础模型进行微调的影响,并训练出一个可与闭源视频生成相媲美的文本到视频模型。该模型为下游任务提供了强大的运动表征,例如图像到视频的生成以及对摄像机运动特定的 LoRA 模块的适应性。除此之外,该模型还能够提供强大的多视图 3D 先验,这可以作为多视图扩散模型的基础,模型以前馈方式生成对象的多个视图,只需要较小的算力需求,性能还优于基于图像的方法。

具体而言,成功训练该模型包括以下三个阶段:

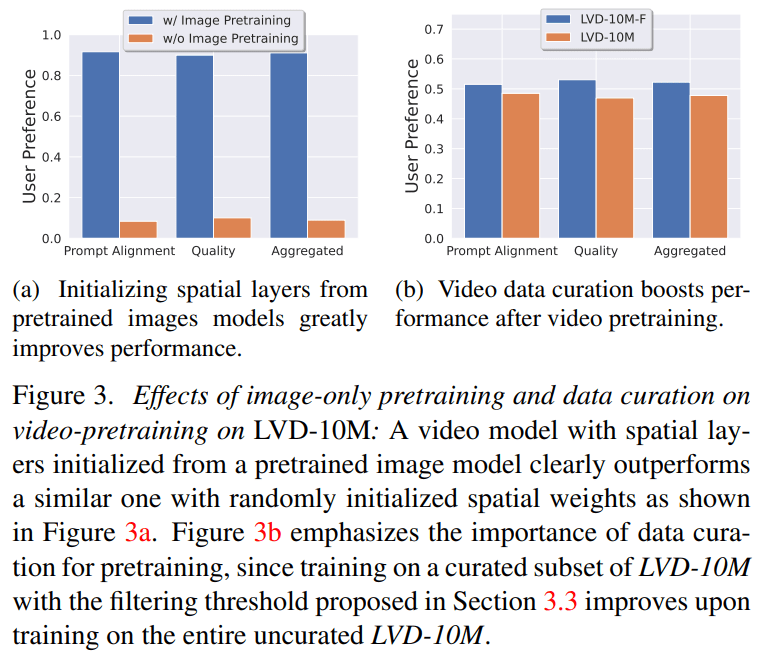

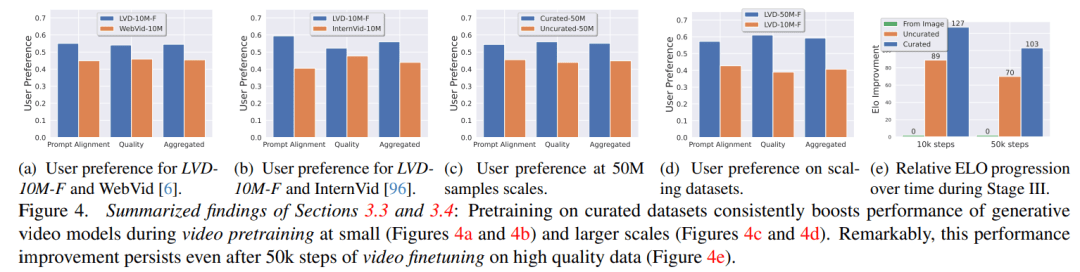

阶段一:图像预训练。本文将图像预训练视为训练 pipeline 的第一阶段,并将初始模型建立在 Stable Diffusion 2.1 的基础上,这样一来为视频模型配备了强大的视觉表示。为了分析图像预训练的效果,本文还训练并比较了两个相同的视频模型。图 3a 结果表明,图像预训练模型在质量和提示跟踪方面都更受青睐。

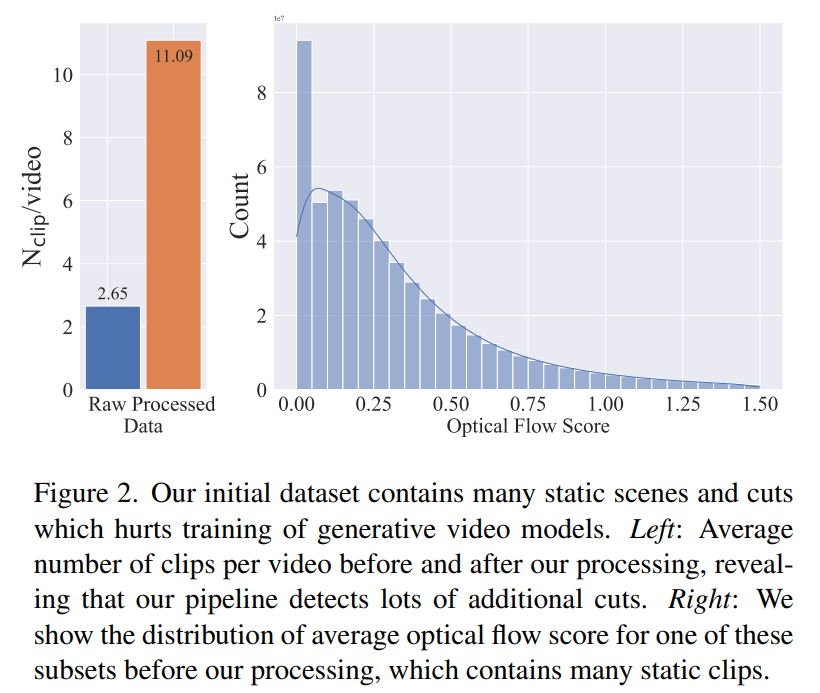

阶段 2:视频预训练数据集。本文依靠人类偏好作为信号来创建合适的预训练数据集。本文创建的数据集为 LVD(Large Video Dataset ),由 580M 对带注释的视频片段组成。

进一步的研究表明生成的数据集包含可能会降低最终视频模型性能的示例。因此,本文还采用了密集光流来注释数据集。

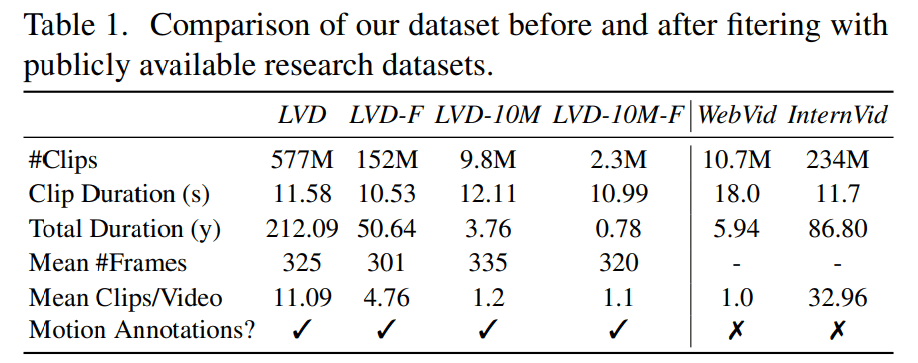

此外,本文还应用光学字符识别来清除包含大量文本的剪辑。最后,本文使用 CLIP 嵌入来注释每个剪辑的第一帧、中间帧和最后一帧。下表提供了 LVD 数据集的一些统计信息:

阶段 3:高质量微调。为了分析视频预训练对最后阶段的影响,本文对三个模型进行了微调,这些模型仅在初始化方面有所不同。图 4e 为结果。

看起来这是个好的开始。什么时候,我们能用 AI 直接生成一部电影呢?

参考内容:

https://stability.ai/news/stable-video-diffusion-open-ai-video-model

https://news.ycombinator.com/item?id=38368287返回搜狐,查看更多

责任编辑:

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号aigc666aigc999或上边扫码,即可拥有个人AI助手!