文章主题:关键词:机器之心,科技领域,变革,谷歌,Bard,AI,ChatGPT,OpenAI,LaMDA,搜索引擎,信息获取,自然语言处理,生成式AI

来自机器之心

欢迎关注 ,专注学术论文、机器学习、人工智能、Python技巧我们可能正在见证科技领域前所未有的变革。

在2月7日的凌晨时分,谷歌公司的首席执行官桑达尔·皮查伊(Sundar Pichai)出人意料地推出了谷歌下一代对话人工智能助手Bard。

自 ChatGPT 风靡全球以来,各大科技巨头纷纷在 AI 领域布局一系列行动,尤其是领军企业谷歌,更是引起人们的广泛关注。据内部消息透露,谷歌的新产品名为 Bard,已被列为公司内部 “code red” 优先级项目,其针对的目标正是备受瞩目的 OpenAI 的 ChatGPT。令人意外的是,Bard 的发布时间比原定的 2 月 8 日提前了一天。

可见,语言模型落地的竞争已经进入了白热化,谷歌不打算把优势拱手让给微软。

Bard是一个由LaMDA所支持的创新型对话AI服务,其目标是融合谷歌大型语言模型的强大能力、智慧以及创造力,以探索世界知识的广度。此服务通过运用网络上的信息,能够提供最新且高品质的回应。目前,该服务的部分公开测试已经启动,我们预计在未来的几周内,将会看到更广泛的测试范围。

在谷歌Bard发布之后,紧随其后的是微软在2月7日宣布将举办一场重要发布会。尽管公司并未透露此次发布会的具体内容,但业界普遍猜测这可能涉及传闻中的ChatGPT与Bing的整合,以及与OpenAI的更深入合作。

看来,真的燃起来了!!!

LaMDA支持的对话AI服务Bard

谷歌首席执行官桑达尔·皮查伊(Sundar Pichai)在一份公开信中表示,该公司持续致力于探索由LaMDA驱动的对话AI助手Bard。目前,Bard已经开启公开测试阶段,并有望在未来的几周内正式上线。

这一次,桑达尔·皮查伊亲自下场发布Bard并邀请测试,表明了谷歌对此项目的重视。

在2022年初,机器之心对背后的技术LaMda进行了深入的剖析。那时,LaMDA模型的参数数量高达1370亿个,这一数字展示了其接近人类水平的对话质量。这一成果得到了广泛关注,甚至谷歌也在其官方博客中提到了这个模型(具体内容可见:1370亿参数、接近人类水平,谷歌对话AI模型LaMDA放出论文)。

而今Bard最初版本将与LaMDA 轻量级模型一起发布,从而需要更小的算力。

谷歌也表示,这一轮测试旨在继续学习从而提高 Bard 的质量和速度。

接下来让我们看下Sundar Pichai公开信全文:

如今,人工智能已经成为我们深入研究的顶级科技。其应用范围广泛,从协助医生尽早识别疾病到让公众通过自然语言轻松获取信息,人工智能都在助力个人、企业及社区的潜力挖掘。它为我们开启了全新的机遇,可以显著改善数十亿人生活质量。这也正是六年前我们重新塑造公司战略的初衷。我们的目标是整合全球信息资源,确保所有人都能平等地访问和使用,而人工智能就是推动这一目标的最重要的工具。

自那以后,我们坚定不移地投身于AI大潮,Google AI与DeepMind的卓越表现极大地推动了AI技术的进步。时至今日,AI计算能力每六个月翻一番的速度远超摩尔定律,这得益于我们持续不断地大量投入。同时,先进的生成式AI和大型语言模型正在激发全球人们的创造力。值得一提的是,我们的Transformer研究项目、2017年的领域论文以及在扩散模型方面的重大突破,已成为当前众多生成式AI应用的关键基础。

Bard

两年前,我们推出了下一代语言和对话技术——LaMDA。两年来我们一直在研究一项由 LaMDA 提供支持的实验性对话式 AI 服务,我们称之为 「Bard」。今天,我们又向前迈进了一步,将其开放给一些测试人员,并在未来几周内将其更广泛地提供给公众。

Bard致力于将广泛的世界知识与大型语言模型的强大功能和创造力结合起来,它利用来自网络的信息为输入问题提供最新、高质量的回答。

Bard掌握广泛的现实知识,能够激发人们的好奇心。例如,Bard可以帮你向 9 岁的孩子解释 NASA 的詹姆斯·韦伯太空望远镜的新发现,或者为您提供关于当前足球界最佳前锋的信息。

最初我们最初将与我们的 LaMDA 轻量级模型版本一起发布。这个小得多的模型需要更少的计算能力,使我们能够扩展到更多的用户,从而获得更多的反馈。我们会将外部反馈与我们自己的内部测试相结合,以确保 Bard 的回应在质量、安全性和接地性方面达到高标准在真实世界的信息中。我们很高兴这一阶段的测试可以帮助我们继续学习和提高 Bard 的质量和速度。

将 AI 的优势带入谷歌日常产品

我们在使用 AI 为数十亿人改进搜索方面有着悠久的历史。BERT 是我们最早的 Transformer 模型之一,它在理解人类语言的复杂性方面具有革命性意义。两年前,我们推出了 MUM,它比 BERT 强大 1000 倍,对信息的理解更上一层楼,多语言,可以挑选视频中的关键时刻并提供关键信息,包括危机支持,更多语言。

现在,我们正在以最新的人工智能技术—如LaMDA、PaLM、Imagen和MusicLM—作为基础,创造全新的信息接触方式,从语言、图像到视频和音频。我们正在努力将这些最新的人工智能进展引入我们的产品,而搜索是一个开始。

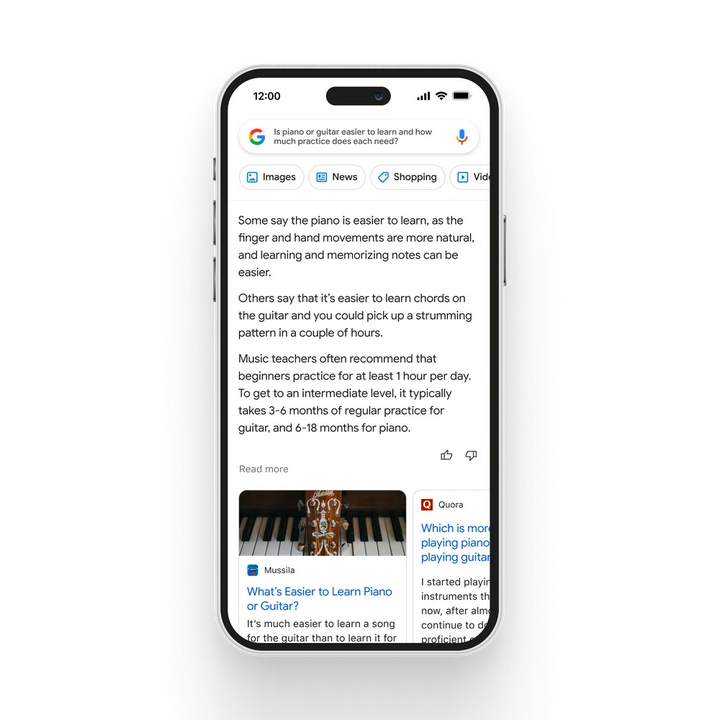

最令人兴奋的机会之一是人工智能如何加深我们对信息的理解,并更高效地将其转化为有用的知识——这让人们更容易找到他们正在寻找的核心内容并完成任务。当人们想到谷歌时,他们通常会想到向我们寻求快速的事实性答案,比如「一架钢琴有多少个键?」但是,人们也越来越多地转向谷歌寻求更深入的见解和理解—比如「钢琴还是吉他更容易学习?每种乐器需要多少练习?」 了解这样的话题可能需要花费很多精力来弄清楚你真正需要知道的东西,人们往往希望探索各种不同的意见或观点。

在这些时候,人工智能可以起到帮助作用,对于没有一个正确答案的问题,人工智能可以合成洞察。很快,你就会在搜索中看到由人工智能驱动的功能,其将复杂的信息和多种观点提炼成易于消化的格式,以便你快速了解全局,并从网络上学到更多东西——无论是寻求额外的观点,如既弹钢琴又弹吉他的人的博客,还是深入了解相关主题,如作为初学者入门的步骤。这些新的人工智能功能将很快开始在谷歌搜索上推出。

在寻找见解时,搜索中的 AI 功能可以提炼信息,帮助你了解全局。

帮助开发人员利用 AI 进行创新

下个月,我们将开始接纳个人开发者、创作者和企业,这样他们就可以尝试我们的语言生成API,最初由LaMDA提供支持,随后会有一系列的模型。

接下来,我们计划创建一套工具和API,使其他人能够轻松地用人工智能建立更多的创新应用。拥有必要的计算能力来构建可靠和值得信赖的人工智能系统对初创企业来说也是至关重要的,我们很高兴通过我们与Cohere通过谷歌云合作来帮助实现这些。

胆大、负责

我们以胆大和负责任的方式,将植根于这些模型中的经验带来全世界,这一点至关重要。这就是我们致力于开发负责任AI的原因所在:2018 年,谷歌是首批发布一系列 AI 原则的公司之一。我们将继续为自己的研究人员提供培训和资源,与政府和外部机构合作制定标准和最佳实践,并与社区和专家一道实现安全和有用的AI。

无论是应用AI以从根本上改造我们自己的产品,还是让其他人使用这些强大的工具,我们将继续大胆地进行创新并在方法探索上秉持负责任的态度。而这仅仅是个开始,在接下来的几周和几个月里,所有这些领域都将迎来更多新东西。

博客地址:https://blog.google/technology/ai/bard-google-ai-search-updates/

技术交流群

建了前沿、实战技术交流群!想要进交流群、获取资料的同学,可以直接加微信号:mlc2060。加的时候备注一下:研究方向 +学校/公司+知乎,即可。然后就可以拉你进群了。

强烈推荐大家关注 机器学习社区 知乎账号和 机器学习社区 微信公众号,可以快速了解到最新优质文章。

前沿技术资讯、算法交流、求职内推、算法竞赛、面试交流(校招、社招、实习)等、与 10000+来自港科大、北大、清华、中科院、CMU、腾讯、百度等名校名企开发者互动交流~

推荐文章

ECCV22 | CMU提出首个快速知识蒸馏的视觉框架:80.1%精度,训练加速30%

CVPR22 最新132篇论文分方向整理|包含目标检测、图像处理、医学影像等28个方向

CVPR 2022 最新 65 篇论文分方向整理,方向包含:目标检测、动作识别、人群计数等方向

CVPR 2022 | CNN自监督预训练新SOTA:上交、Mila、字节联合提出具有层级结构的图像表征自学习新框架

谷歌提出新模型 FLASH,让 Transformer 模型的效率倍增!训练成本暴减!

阿里、SFU提出通用QuadTree Attention,复杂度变线性,性能还更强!ICLR 2022已接收

学习视觉和语言的多粒度对齐?字节提出新多模态预训练方法 X-VLM:代码已开源!

超越ConvNeXt,VAN用普通卷积,登顶Backbone性能巅峰!

深度学习中的 Attention 机制总结与代码实现(2017-2021年)

大道至简,何恺明新论文火了:Masked Autoencoders让计算机视觉通向大模型

关键词:机器之心,科技领域,变革,谷歌,Bard,AI,ChatGPT,OpenAI,LaMDA,搜索引擎,信息获取,自然语言处理,生成式AI

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号aigc666aigc999或上边扫码,即可拥有个人AI助手!