趣加音乐总监张志伟:详解AI技术在游戏音频领域的改变与帮助刀郎闯祸了?《颠倒歌》映射太多人,网友:在作死的边缘疯狂试探

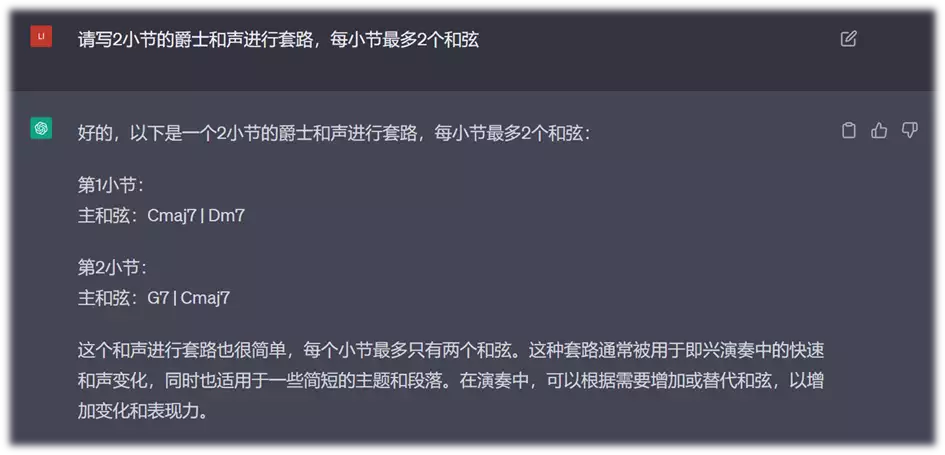

随着ChatGPT与AIGC行业的迅速发展,虚拟人、音频模仿、智能NPC等应用场景也成为了各家游戏厂商关注的焦点。而作为业内领先的研发型企业,趣加也早已布局AI赛道,通过挖掘AI技术潜力的方式进一步提升游戏研发效能,同时力争为用户提供更好服务。 围绕这一核心目标,趣加音频总监张志伟也在内部分享了名为“AI of Game Audio”的主题演讲。张老师通过深入浅出的讲解,从灵感参考、分轨辅助、语音及引擎脚本等层面,详细地介绍了当前AI技术在游戏音频创作中的应用场景。 以下为内容实录: 大家好,我是张志伟,很高兴能和大家分享有关“AI of Game Audio”这一主题的最新研究成果。 广义的来说AI早已在游戏、音乐等领域中出现与应用。今年让我们激动的是近来发展迅猛的AIGC,生成式AI。 虽然我们还没有让普通人实现从意识到实际行为的脑机接口,但是拥有神经网络、深度学习的生成式AI,已先一步变得越来越能理解人的需求,并且开始取代一些传统生产环节。 AIGC技术的掌握和操作,难度看起来比传统学习一门专业要简单。拿音乐来举例,音乐创作是一个人需要多年学习训练、实践后才能驾驭的。如今AIGC可以让文字、语音等直接生成音乐。 那么,当下火热的AI技术在游戏音频领域,能带来哪些改变和帮助呢? 游戏音频 游戏音频主要分4个部分:音乐(bgmmusic)、语音(voices)、音效(sound sfx)、声音引擎(sound engine)。从开发流程来看包含:设计、制作生产、引擎逻辑、音频QA等。在我们近期的实践中发现,AI技术可以在设计方案、制作生产等方面帮助音频设计师提速,从而赋能游戏项目。 AI音乐 传统的音乐制作流程,无论是歌曲还是配乐,基础环节包括了创作、制作两部分。展开讲分别是作曲、作词、编曲、配器、器乐录音、人声录音、混音、母带等。每个环节都需要专业人员参与,即便在数字音乐制作普及的今天,把多个环节集中于一人身上,但是这个人自身是需要多年的专业学习和项目经验的。 在传统音乐制作中,声音合成技术几十年前就已在应用。载体是合成器(乐器),核心能力就是无中生有地创造出世界上从来没有的声音。但其生产模式是需要懂得专业知识的人来操作,还是离不开人的深度参与。 音乐生成AI化的一些重要节点: 1)人工输入大量核心作曲信息 1990年已诞生了自动作曲软件Band-in-a-box,在这里我们称其为“传统自动作曲”。作曲人员输入和声、曲风等设定后产生音乐。因其自身的特点和一些限制,后来它逐渐变成了音乐专业学习中,学习曲风的辅助工具。 2)人工输入模糊作曲信息 2016年出现了AIVA,我们称其为“AI自动作曲” 。操作模式是作曲人员设定曲风、调式等参数后,软件据此生成完整的音乐工程。接下来在AI软件中进行基于MIDI工程的编辑,或者输出MIDI文件和音频分轨,导入音频宿主软件进行深度的修改。这样的AI音乐技术,是能生成更多可能性的音乐,同时允许作曲者来进行反复地修改。 3)人工输入文字、图片 当下的AI音乐生成,可以不需要音乐理论知识和专业能力。输入文字、图片即可生成音乐。当然,音乐是否符合需求,取决于AI训练等很多因素。 AI音乐在游戏音频开发中能做什么呢? 第一:作曲辅助工具,快捷的提供灵感和参考。 1)ChatGPT+传统自动作曲 首先我们在ChatGPT中进行提问,获得和声、调式、配器特点等信息,然后输入到传统自动作曲软件中。 在此过程中,可以结合作曲软件的优势进行更多设定。 广告 胆小者勿入!五四三二一…恐怖的躲猫猫游戏现在开始! × 2)AI自动作曲+专业编曲技能 前面提到AI自动作曲软件允许我们提前设定一些条件,比如曲风、调式等。由此获得一段基于目标信息的音乐,还提供MIDI工程以及分轨,让作曲者能相对快速地展开创作。 广告 从秘书起步,十年内无人超越,以一己之力力挽狂澜成就一段传奇 × 3)AIGC 生成式AI让音乐创作变得更加方便,拿MusicLM举例,它在识别文字、音频、图片后,直接生成AI理解出来的音乐。 以上方式虽不能100%获得直接应用的音乐,但是可以让更多概念、想法、意向等转变出对应的音乐灵感和创作参考。 第二:产出风格化、类型化的音乐...