数据格式转换秘籍:如何高效地从斯坦福大羊驼到ChatGLM-6B?🚀

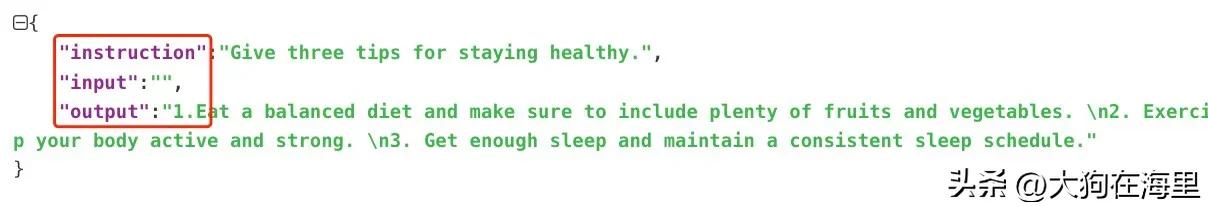

该文章旨在强调开源项目在各行业的进步中所扮演的重要角色,并提倡尊重作者。文中提到,通过学习ChatGLM-6B的开源项目,可以快速实现私有对话机器人,但强调数据准备阶段是关键,需要使用`cover_alpaca2jsonl.py`工具将斯坦福大羊驼的数据转换为适合的学习格式。同时,该代码存在一个小问题,即git生成的jsonl文件中空字符串被误作为"Answer: "。作者建议读者查看源代码以了解详情,并提供了修正此问题的提示。最后,文章指出在这个快速变化的时代,持续学习的能力是避免35岁职业危机的关键。